图文教程

在人工智能技术快速发展的背景下,本地部署AI模型已成为众多企业与开发者的重要选择。为满足不同场景下的业务需求,DeepSeek、Qwen、MiniCPM-V-8B等主流模型提供了从轻量级到超大规模的多种版本。然而,面对各版本在参数规模、推理能力、资源消耗等方面的差异,如何根据自身硬件条件与任务复杂度做出合理选择,成为用户关注的核心问题。本文将从模型版本特点、适用场景及部署工具三个方面,系统介绍本地部署模型的选择方法,帮助用户高效匹配最适合自身需求的解决方案。

一、模型介绍

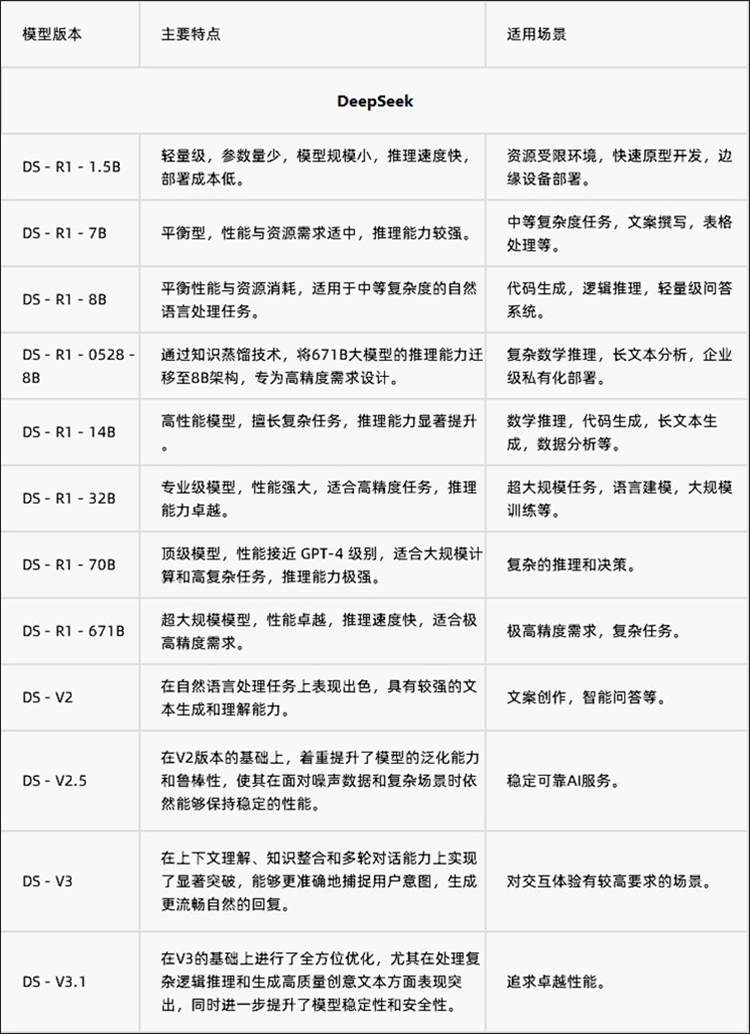

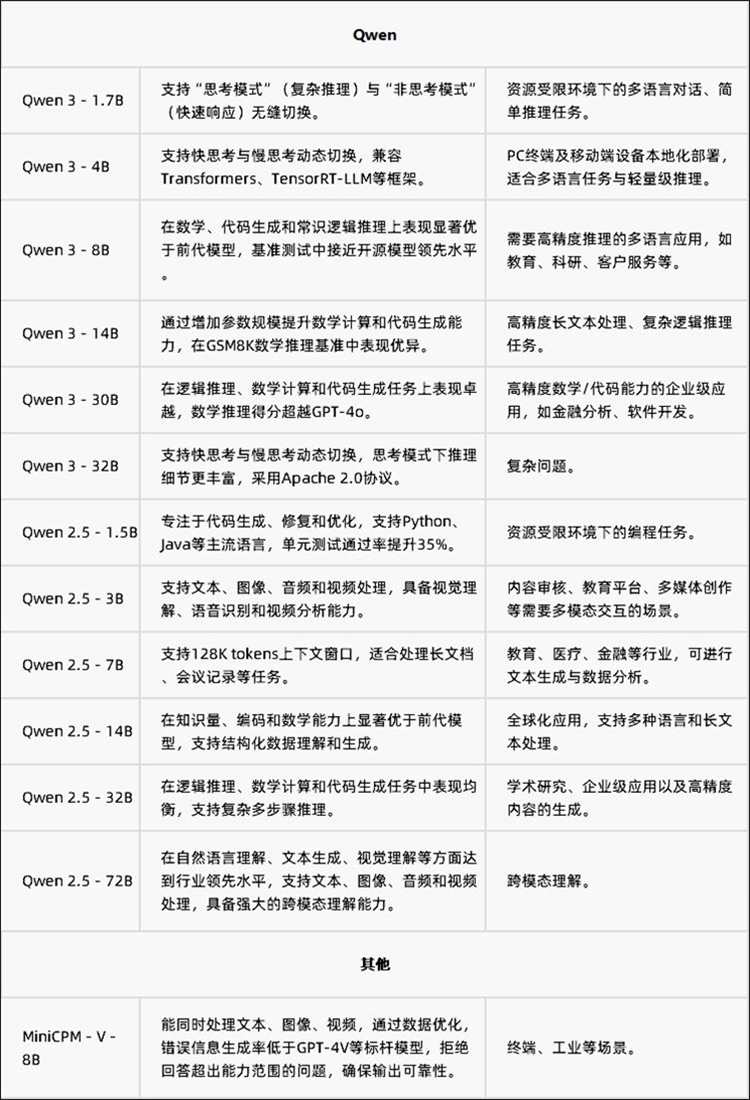

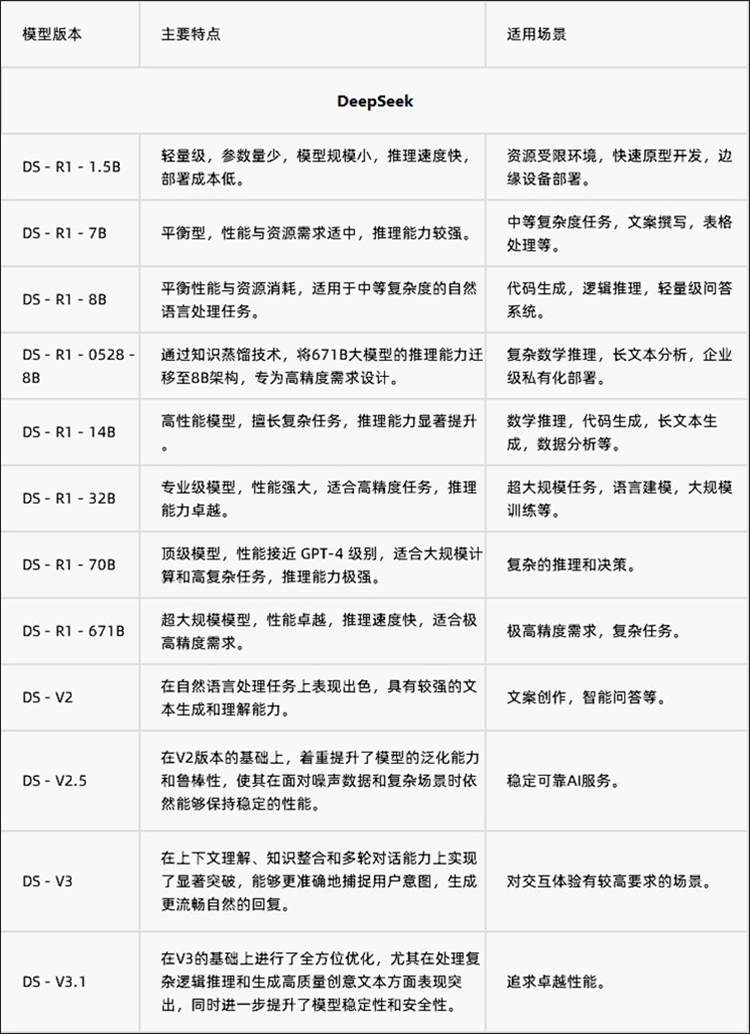

1.关于DeepSeek的模型版本

DeepSeek的模型版本涵盖了多种功能与性能特点,能够满足不同用户在自然语言处理、文本生成、数据分析等多场景下的多样化需求。另外,通过持续迭代优化,还可以为用户提供更加可靠的人工智能服务。 以下是主要版本及其特点: DS – R1 – 1.5B:轻量级模型,参数量少,模型规模小,适合资源受限环境;推理速度快,可在消费级硬件(如普通电脑)上运行;部署成本低,适合快速原型开发或边缘设备部署。 DS – R1 – 7B:平衡型模型,性能与资源需求适中,适合中等复杂度任务;推理能力较强,能处理文案撰写、表格处理等任务。 DS – R1 – 8B:以平衡性能与资源消耗为核心定位,适用于中等复杂度的自然语言处理任务(如代码生成、逻辑推理、轻量级问答系统)。 DS – R1 – 0528 – 8B:通过知识蒸馏技术,将671B大模型的推理能力迁移至8B架构,实现“小体积、大智慧”;专为高精度需求设计(如复杂数学推理、长文本分析、企业级私有化部署)。 DS – R1 – 14B:高性能模型,擅长复杂任务,如数学推理、代码生成等;推理能力显著提升,能处理长文本生成、数据分析等任务。 DS – R1 – 32B:专业级模型,性能强大,适合高精度任务;推理能力卓越,能处理超大规模任务,如语言建模、大规模训练等。 DS – R1 – 70B:顶级模型,性能接近 GPT-4 级别,适合大规模计算和高复杂任务;推理能力极强,能进行复杂的推理和决策。 DS – R1 – 671B:超大规模模型,性能卓越,推理速度快,适合极高精度需求;采用 MoE 架构,支持超长上下文(128K tokens),在复杂任务上表现顶尖。 DS – V2:在自然语言处理任务上表现出色,具有较强的文本生成和理解能力,能够胜任诸如文案创作、智能问答等多种任务,是希望快速提升工作效率的用户的得力助手。 DS – V2.5:在V2版本的基础上,V2.5着重提升了模型的泛化能力和鲁棒性,使其在面对噪声数据和复杂场景时依然能够保持稳定的性能,是追求稳定可靠AI服务的用户的明智之选。 DS – V3:作为V系列的重要里程碑,在上下文理解、知识整合和多轮对话能力上实现了显著突破,能够更准确地捕捉用户意图,生成更流畅自然的回复,适用于对交互体验有较高要求的场景。 DS – V3.1:在V3的基础上进行了全方位优化,尤其在处理复杂逻辑推理和生成高质量创意文本方面表现突出,同时进一步提升了模型稳定性和安全性,是追求卓越性能用户的理想之选。2.关于Qwen的模型版本

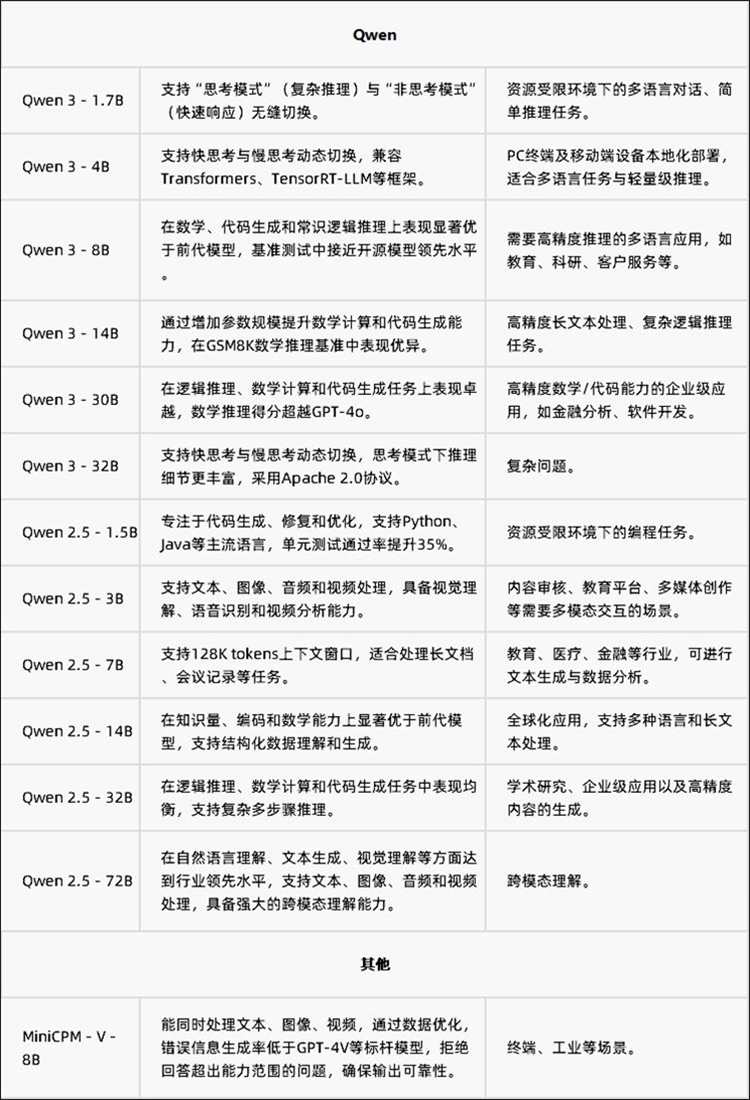

Qwen的模型系列覆盖从轻量到超大规模的多个版本,能够在对话、创作、推理、代码等丰富场景下提供稳定且高质量的语言理解与生成能力;同时依托持续开源迭代与社区反馈,不断提升安全性、知识时效性与多语言表现。 以下是主要版本及其特点: Qwen 3系列 Qwen 3 – 1.7B:支持“思考模式”(复杂推理)与“非思考模式”(快速响应)无缝切换,用户可根据任务需求调整推理深度;可在资源受限环境下进行多语言对话、简单推理任务。 Qwen 3 – 4B:支持快思考与慢思考动态切换,兼容Transformers、TensorRT-LLM等框架;可在PC终端及移动端设备进行本地化部署,适合多语言任务与轻量级推理。 Qwen 3 – 8B:在数学、代码生成和常识逻辑推理任务上表现显著优于前代模型,基准测试中接近开源模型领先水平;适合需要高精度推理的多语言应用,如教育、科研、客户服务等。 Qwen 3 – 14B:通过增加参数规模提升数学计算和代码生成能力,在GSM8K数学推理基准中表现优异;能够进行高精度长文本处理、复杂逻辑推理任务。 Qwen 3 – 30B:在逻辑推理、数学计算和代码生成任务上表现卓越,数学推理得分超越GPT-4o;适用于高精度数学/代码能力的企业级应用,如金融分析、软件开发。 Qwen 3 – 32B:支持快思考与慢思考动态切换,思考模式下推理细节更丰富,适合复杂问题;采用Apache 2.0协议,允许自由使用、修改和商业化。 Qwen 2.5系列 Qwen 2.5 – 1.5B:专注于代码生成、修复和优化,支持Python、Java等主流语言,单元测试通过率提升35%;可在消费级GPU上高效运行,适合资源受限环境下的编程任务。 Qwen 2.5 – 3B:支持文本、图像、音频和视频处理,具备视觉理解、语音识别和视频分析能力;可用于内容审核、教育平台、多媒体创作等需要多模态交互的场景。 Qwen 2.5 – 7B:支持128K tokens上下文窗口,适合处理长文档、会议记录等任务,适用于教育、医疗、金融等行业,可进行文本生成与数据分析。 Qwen 2.5 – 14B:在知识量、编码和数学能力上显著优于前代模型,支持结构化数据理解和生成;支持多种语言和长文本处理,适合全球化应用。 Qwen 2.5 – 32B:在逻辑推理、数学计算和代码生成任务中表现均衡,支持复杂多步骤推理;可用于学术研究、企业级应用以及高精度内容的生成。 Qwen 2.5 – 72B:在自然语言理解、文本生成、视觉理解等方面达到行业领先水平;持文本、图像、音频和视频处理,具备强大的跨模态理解能力。3.关于文本处理模型

MiniCPM – V – 8B能同时处理文本、图像、视频,支持“看图说话”“视频问答”“多图对比分析”等功能;通过数据优化,错误信息生成率低于GPT-4V等标杆模型,拒绝回答超出能力范围的问题,确保输出可靠性;技术开源且生态活跃,广泛用于终端、工业等场景。 为了便于用户快速了解,具体整理如下表:

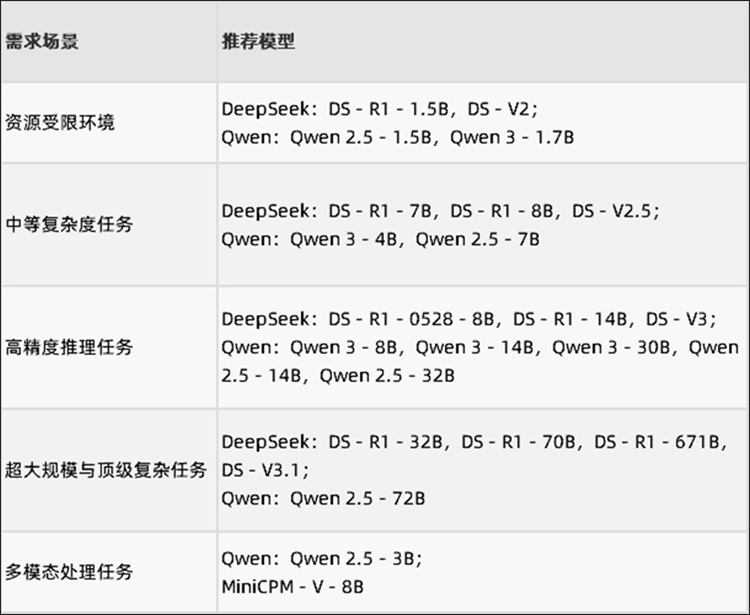

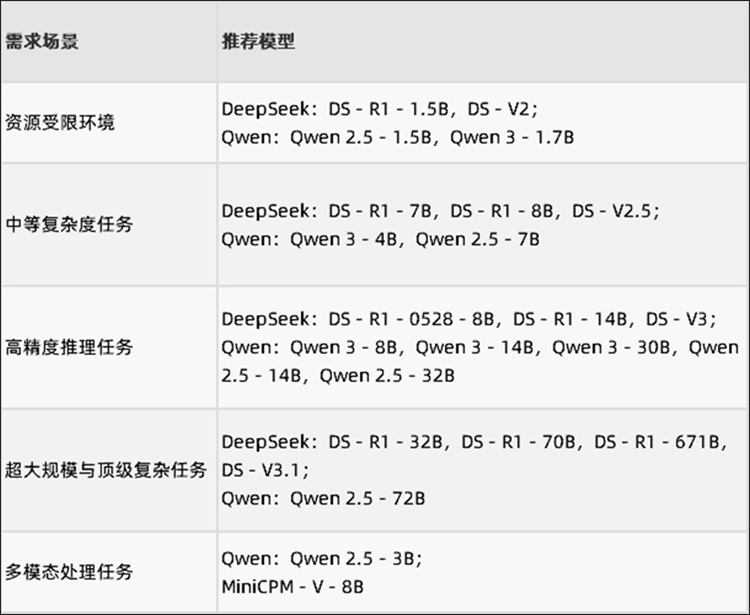

二、模型版本选择推荐

以下是根据不同需求场景,对 DeepSeek、Qwen 及 MiniCPM – V – 8B 模型的选择推荐:1.资源受限环境

适用场景:个人电脑、边缘设备等资源有限处运行基础任务。 推荐模型: DeepSeek:DS – R1 – 1.5B,轻量、速快、成本低;DS – V2 基础 NLP 能力,快速上手。 Qwen:Qwen 2.5 – 1.5B 适合编程;Qwen 3 – 1.7B 适合多语言对话与简单推理。2.中等复杂度任务

适用场景:文案撰写、表格处理、轻量级问答、多语言轻量推理等。 推荐模型: DeepSeek:DS – R1 – 7B 平衡性能与资源;DS – R1 – 8B 平衡性能与资源消耗;DS – V2.5 性能与效率平衡,特定任务表现出色。 Qwen:Qwen 3 – 4B 适合多语言轻量推理;Qwen 2.5 – 7B 适合长文档处理。3.高精度推理任务

适用场景:复杂数学推理、长文本分析、企业级应用、教育科研等。 推荐模型: DeepSeek:DS – R1 – 0528 – 8B 高精度小体积;DS – R1 – 14B 高性能复杂任务;DS – V3 上下文理解、知识整合、多轮对话能力强。 Qwen:Qwen 3 – 8B 高精度多语言推理;Qwen 3 – 14B 高精度长文本推理;Qwen 3 – 30B 企业级高精度应用;Qwen 2.5 – 14B 全球化高精度应用;Qwen 2.5 – 32B 学术企业高精度内容生成。4.超大规模与顶级复杂任务

适用场景:大规模计算、高复杂任务、语言建模、大规模训练等。 推荐模型: DeepSeek:DS – R1 – 32B 超大规模任务;DS – R1 – 70B 顶级复杂推理决策;DS – R1 – 671B 超大规模极高精度;DS – V3.1 复杂逻辑推理和生成高质量创意文本方面表现突出。 Qwen:Qwen 2.5 – 72B 跨模态理解行业领先。5.多模态处理任务

适用场景:同时处理文本、图像、视频等,如内容审核、多媒体创作。 推荐模型: Qwen:Qwen 2.5 – 3B 多模态交互。 MiniCPM – V – 8B:多模态处理,输出可靠,应用广泛。 AI 模型推荐表: